在日常的编码工作中,引入 AI 辅助已经成为一种趋势。但一个现实问题也随之而来:市面上的大语言模型数量繁多,哪些真正适合作为编码助手?即便选定了某个模型,不同服务商提供的 API 在配置和优化上存在差异,最终得到的性能和质量也可能千差万别。这种不确定性,给追求高效和稳定的开发体验带来了挑战。

为了解决这个问题,一个名为 OpenCode Zen 的服务应运而生。它并非又一个新的大模型,而是一个 AI 网关(AI Gateway),其核心价值在于提供了一份经过严格测试和验证的精选模型列表。

什么是 OpenCode Zen?

简单来说,OpenCode Zen 是 OpenCode 团队维护的一个模型“优选清单”。当前,许多开发者可能会通过像 OpenRouter 这样的模型聚合平台来访问不同模型,但这种方式往往无法保证获得特定模型的最佳性能版本。因为模型的实际表现不仅取决于其本身,还与服务提供商的部署方式、服务器配置等因素密切相关。

OpenCode Zen 的目标正是消除这种不确定性。它通过一套严谨的流程,确保开发者能够稳定地使用到高质量的编码模型。

这个流程可以概括为三个核心步骤:

- 严格筛选与测试:团队首先会筛选出那些在编码任务中表现出色的模型,并与模型开发团队直接沟通,了解其最佳运行配置。

- 协同优化:随后,与一部分服务提供商合作,确保这些被选中的模型能够以最优化的方式被部署和提供服务。

- 基准测试与推荐:最后,对“模型+服务商”的组合进行基准测试,最终形成一份团队认可并推荐的列表。

通过这个过程,OpenCode Zen 将这些经过验证的模型整合到一个统一的 AI 网关中,开发者只需连接 Zen,即可访问这个“优选清单”,而不必再为模型的选择和性能表现感到担忧。

如何开始使用

将 OpenCode Zen 集成到工作流中的过程很简单。它就像在 OpenCode 中连接任何一个标准的模型服务商一样。

获取并配置 API 密钥

使用的第一步是获取访问凭证。需要登录到 OpenCode Zen 的官方网站,添加支付方式并生成一个 API 密钥。

获取密钥后,就可以在 OpenCode 的 TUI(文本用户界面)中使用 /connect 命令来配置。在弹出的服务商列表中选择 OpenCode Zen,然后粘贴刚刚复制的 API 密钥即可完成连接。

/connect

连接成功后,可以通过 /models 命令查看当前所有可用的、经过 Zen 推荐的模型列表。

/models

直接通过 API 访问

除了在 OpenCode TUI 中使用,OpenCode Zen 也提供了标准的 API 端点。这意味着可以将这些精选模型集成到任何支持 HTTP API 调用的自定义工具或应用程序中。

例如,gpt-5.2-codex 模型的 API 端点地址是:

https://opencode.ai/zen/v1/responses

在 OpenCode 的配置文件中指定模型时,需要使用 opencode/<model-id> 的格式。例如,要使用 gpt-5.2-codex,配置项应写作 opencode/gpt-5.2-codex。

模型与定价策略

OpenCode Zen 的一大特色是其透明且对开发者友好的定价策略,以及背后丰富的模型选择。

精选模型列表

Zen 整合了当前市面上最主流和强大的编码模型,包括 OpenAI 的 GPT 系列、Anthropic 的 Claude 系列、Google 的 Gemini 系列,以及像智谱 GLM、月之暗面 Kimi、阿里通义千问 Qwen 等国产优秀模型。

值得注意的是,其中一部分模型在特定时期内是免费提供的。例如,Grok Code Fast 1、GLM 4.7 等模型目前处于免费测试阶段,其目的是为了收集用户反馈以进一步改进模型。

透明的定价模型

Zen 采用按使用量付费(Pay-as-you-go)的模式,以每百万 token 为单位进行计费。其定价目标是“按成本销售”,除了覆盖必要的支付处理费用(例如信用卡手续费)外,几乎没有额外加价。当模型提供方降价时,这部分优惠也会直接传递给用户。

下表展示了部分代表性模型的定价信息,以便有一个直观的了解。

| 模型 (Model) | 输入 (Input/1M tokens) | 输出 (Output/1M tokens) | 备注 (Notes) |

|---|---|---|---|

| GPT 5.2 Codex | $1.75 | $14.00 | 专为代码优化 |

| Claude 3.5 Haiku | $0.80 | $4.00 | 高性价比,快速响应 |

| Gemini 3 Flash | $0.50 | $3.00 | Google 的轻量级高效模型 |

| Kimi K2 | $0.40 | $2.50 | 国产大模型,支持长文本 |

| Grok Code Fast 1 | Free | Free | 限时免费,用于收集反馈 |

| Big Pickle | Free | Free | 限时免费的神秘模型 |

这种定价策略清晰地传达了 Zen 的核心理念之一:不通过差价盈利,而是专注于提供高质量、可靠的模型访问服务。

成本与隐私管理

对于任何付费服务,成本控制和数据隐私都是开发者最关心的问题。OpenCode Zen 提供了灵活的工具来管理这两方面。

灵活的账单控制

Zen 提供了自动充值(Auto-reload)功能。当账户余额低于特定阈值(默认为 5 美元)时,系统会自动充值一定金额(默认为 20 美元)。这个功能以及具体的金额都可以根据个人需求进行调整,或者完全关闭。

同时,可以为整个工作空间或团队中的每个成员设置月度消费上限(Monthly Limits)。例如,为一个成员设置了 20 美元的月度限额,那么当月其消费达到该额度后将无法再继续使用,这为团队预算管理提供了有效的控制手段。

严肃的隐私政策

数据隐私是重中之重。OpenCode Zen 的所有模型都托管在美国,其合作的服务商普遍遵循零数据保留(zero-retention)政策,即不会使用用户数据来训练模型。

但其中存在一些明确的例外情况,Zen 对此也做了透明的说明:

- 免费模型:

Grok Code Fast 1、GLM 4.7等在免费期间收集的数据可能会被用于模型改进。 - 特定服务商政策:通过 Zen 访问 OpenAI 和 Anthropic 的 API 时,请求数据将根据它们各自的数据政策分别保留 30 天。

了解这些细节,有助于在使用时做出符合自己或团队隐私要求的选择。

开发必备:API 全流程管理神器 Apifox

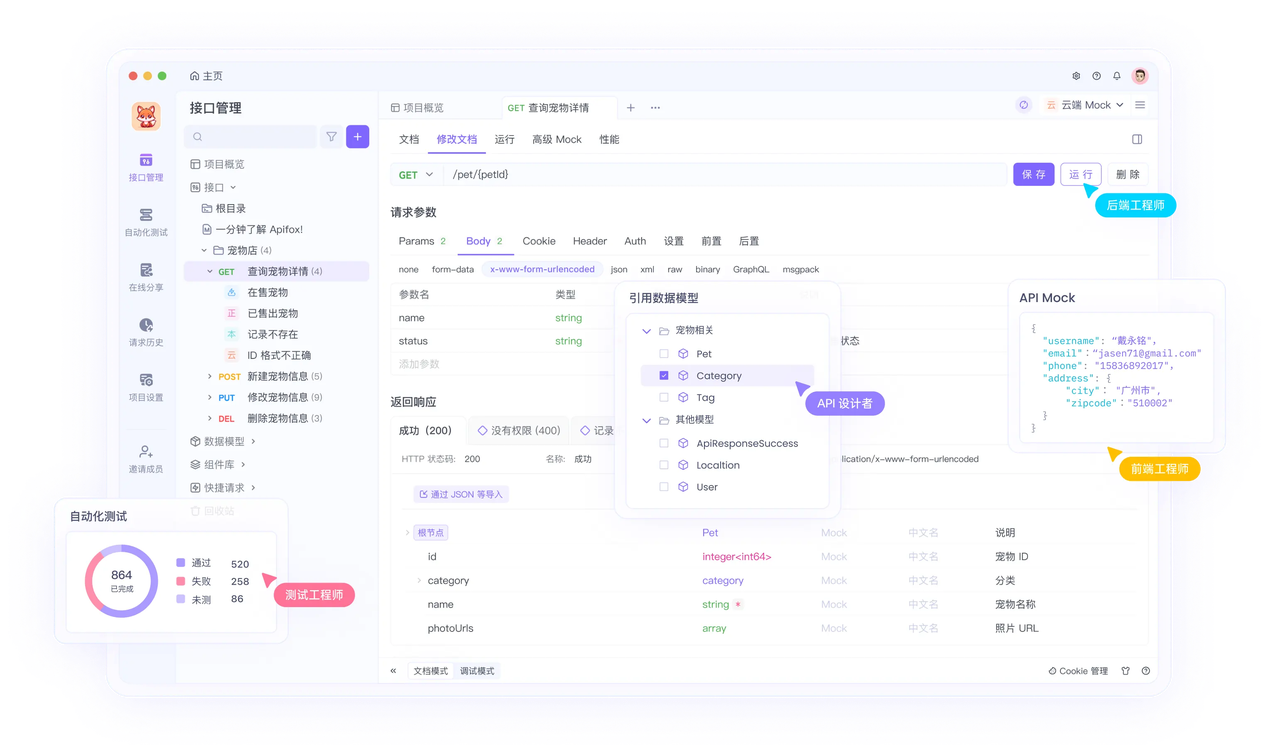

介绍完上文的内容,我想额外介绍一个对开发者同样重要的效率工具 —— Apifox。作为一个集 API 文档、API 调试、API 设计、API 测试、API Mock、自动化测试等功能于一体的 API 管理工具,Apifox 可以说是开发者提升效率的必备工具之一。

如果你正在开发项目需要进行接口调试,不妨试试 Apifox。注册过程非常简单,你可以直接在这里注册使用。

注册成功后可以先看看官方提供的示例项目,这些案例都是经过精心设计的,能帮助你快速了解 Apifox 的主要功能。

使用 Apifox 的一大优势是它完全兼容 Postman 和 Swagger 数据格式,如果你之前使用过这些工具,数据导入会非常方便。而且它的界面设计非常友好,即使是第一次接触的新手也能很快上手,快去试试吧!