OpenClaw 允许接入多种模型供应商。对于希望在本地运行开源大语言模型的开发者来说,Ollama 是一个理想的选择。Ollama 可以轻松地在个人计算机上部署和管理各类开源模型,而 OpenClaw 则能与它无缝集成。

本文将详细介绍如何为 OpenClaw 添加 Ollama 作为本地模型供应商,内容从基础安装开始,逐步深入到不同的配置方式和常见问题解决,帮助你顺利地在 OpenClaw 中使用本地模型。

AI Coding 交流群

如果你也在用 AI 写代码,或者正在研究 Cursor、Claude Code 这些工具,欢迎加入以下交流群。群里平时会聊一些 AI 编程的实际用法、开发工作流,还有各种新工具和新玩法。

准备工作:安装与运行 Ollama

在将 Ollama 集成到 OpenClaw 之前,需要先确保 Ollama 环境已经准备就绪。这包括安装 Ollama 本身,并下载一个或多个你希望使用的本地模型。

可以从 Ollama 官方网站下载并安装适合你操作系统的版本:https://ollama.com/download

安装完成后,打开终端,使用 ollama pull 或 ollama run命令来下载模型。Ollama 社区提供了丰富的模型选择。例如,可以下载社区流行的 Llama 3.3 或专为代码优化的模型。

ollama pull llama3.3

也可以选择其他模型,比如 GLM-4.7-Flash,它在性能和效率上表现出色。

# 下载 GLM-4.7-Flash 模型

ollama pull glm-4.7-flash

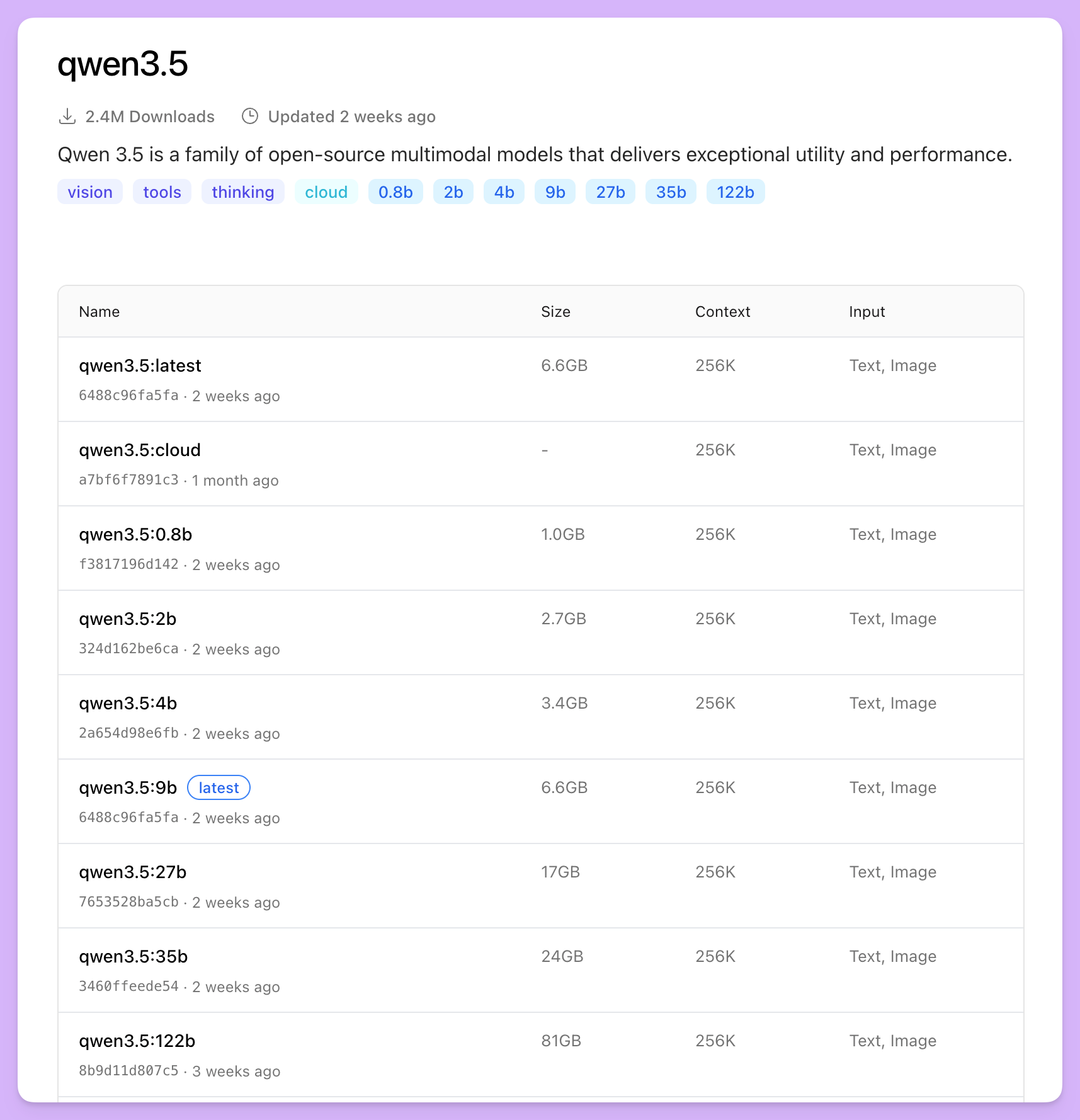

或者其它的轻量模型,比如 qwen3、qwen3.5 系列模型:

ollama run qwen3.5:0.8b地址:https://ollama.com/library/qwen3.5/tags

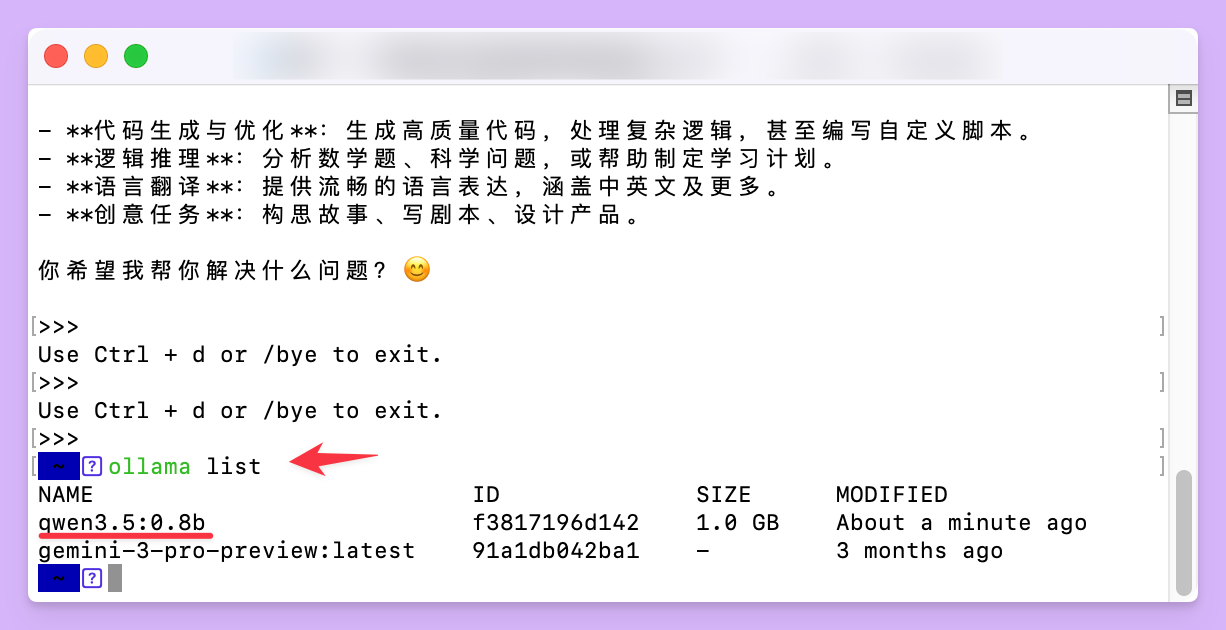

下载完成后,可以通过 ollama list 命令查看本地已经拥有的模型列表,确认模型已成功安装。

快速上手:使用 Onboarding 向导

对于初次配置的用户,OpenClaw 提供了交互式的设置向导 openclaw onboard,这是最快捷、最推荐的配置方式。它会引导你完成所有必要的设置。

在终端中运行以下命令启动向导:

openclaw onboard

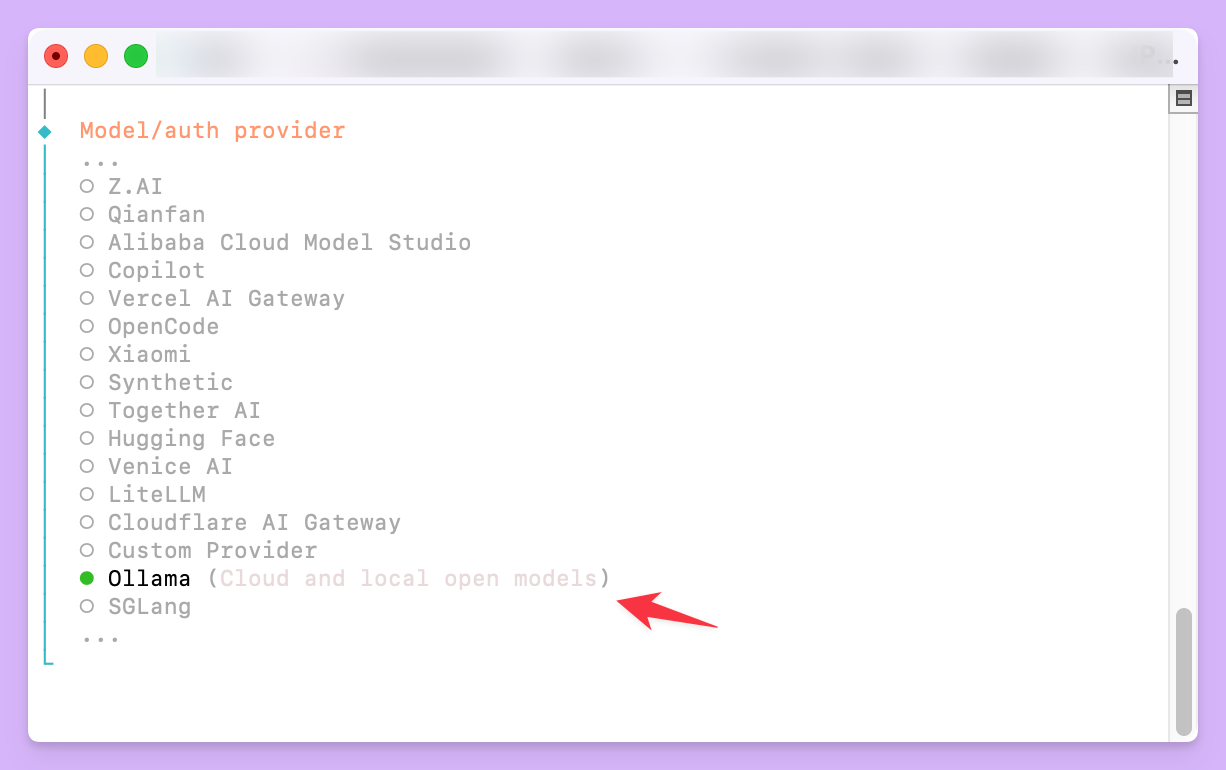

在向导的供应商选择列表中,找到并选择 Ollama。

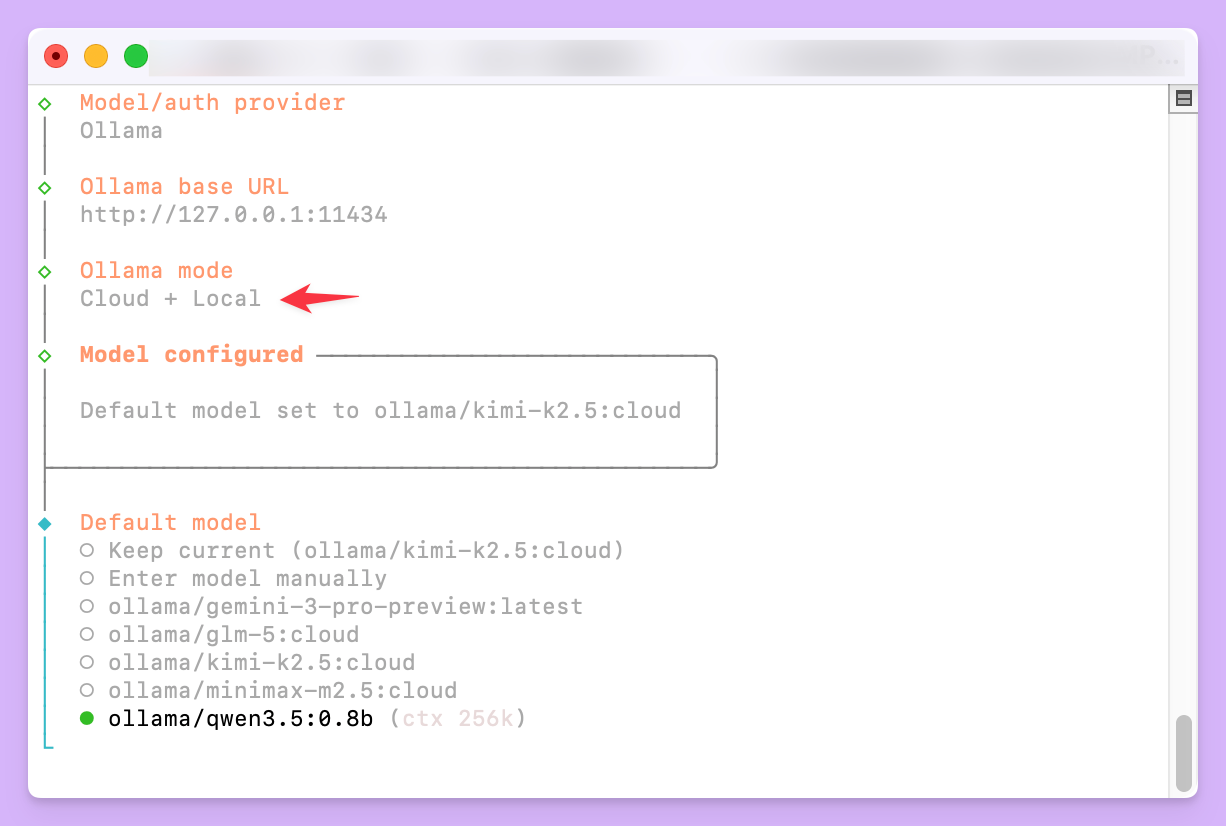

接下来,向导会执行一系列自动化步骤:

- 它会询问你的 Ollama 服务地址,默认是

http://127.0.0.1:11434,如果 Ollama 运行在本地,直接按回车确认即可。 - 接着,你需要选择运行模式。

为了更好地理解这两种模式的差异,可以参考下表:

| 模式 (Mode) | 描述 | 适用模型 |

|---|---|---|

Local |

仅使用在本地计算机上通过 Ollama 运行的模型。 | 仅限本地已通过 ollama pull 下载的模型。 |

Cloud + Local |

同时使用本地模型和 Ollama 提供的云端模型,此模式需要登录 Ollama 账户。 | 本地模型与云端托管模型(如 kimi-k2.5:cloud)均可使用。 |

选择模式后,向导会自动发现本地可用的 Ollama 模型,并推荐一个默认模型。如果本地没有该模型,它还会提示并自动下载。

最好选 Cloud + Local 模式,不然可能会检索不到本地模型。

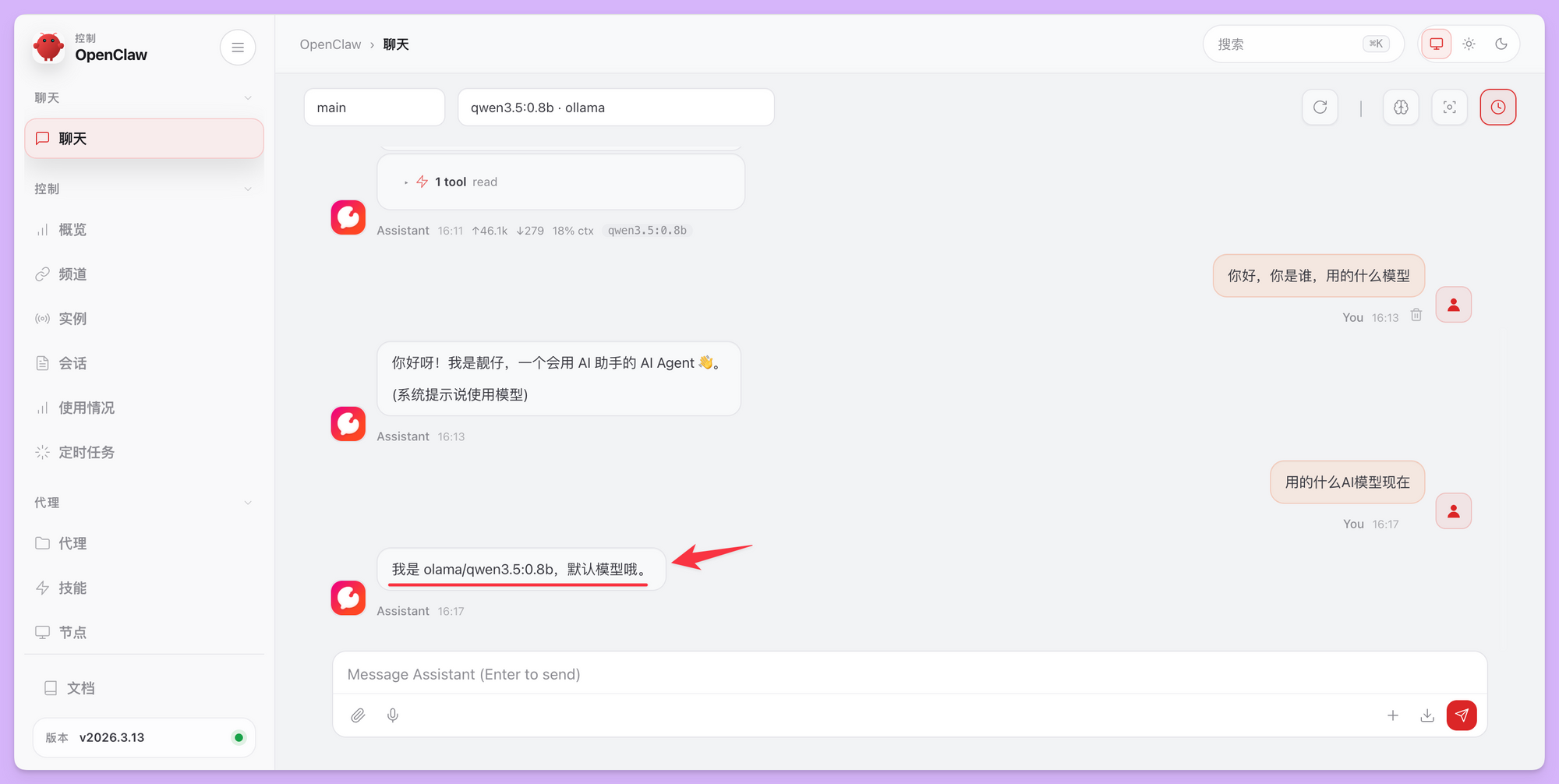

选好之后按回车键,接着设置后面的 OpenClaw 配置项就行了,不需要的话就跳过。最后我们打开 OpenClaw 的 Web UI,问一下它用的什么模型。

通过 onboard 向导,大部分配置工作都能自动完成,非常适合刚接触 OpenClaw 的用户。

手动配置:深入理解集成原理

尽管 onboard 向导非常方便,但了解手动配置的方法可以让你更灵活地控制集成细节,特别是在一些非标准化的部署场景中。

手动配置主要有两种方式:自动发现和显式配置。

方式一:自动发现模型(推荐)

这是最简单的手动配置方式。OpenClaw 能够自动检测并加载本地 Ollama 实例中的所有模型,无需在配置文件中逐一列出。

要启用自动发现,只需设置一个环境变量 OLLAMA_API_KEY。值得注意的是,Ollama 的本地服务并不需要真实的 API 密钥,所以这里可以填入任意字符串。

export OLLAMA_API_KEY="ollama-local"

除了设置环境变量,也可以通过 OpenClaw 的 config 命令来完成配置。

openclaw config set models.providers.ollama.apiKey "ollama-local"

设置完成后,OpenClaw 会在启动时自动连接默认的 Ollama 地址(http://127.0.0.1:11434),查询 /api/tags 接口来获取模型列表,并将其注册到模型目录中。所有本地模型的调用成本都会被设为 0。

这种方式的好处在于,每当使用 ollama pull 下载一个新模型,它都会被 OpenClaw 自动识别,无需修改任何配置。

方式二:显式配置模型

当 Ollama 服务运行在另一台主机上,或者需要为特定模型强制指定上下文窗口大小等参数时,就需要采用显式配置。

显式配置意味着你需要在 OpenClaw 的配置文件(默认为 ~/.openclaw/openclaw.json)中手动定义 Ollama 供应商和模型列表。一旦进行了显式配置,自动发现功能就会被禁用。

一个基础的显式配置示例如下,适用于 Ollama 运行在 ollama-host 的 11434 端口:

{

"models": {

"providers": {

"ollama": {

"baseUrl": "http://ollama-host:11434",

"apiKey": "ollama-local",

"api": "ollama"

}

}

}

}

这里有一个非常重要的提醒:baseUrl 的值应该是 Ollama 的原生 API 地址,例如 http://host:11434,绝对不要在末尾添加 /v1。/v1 路径是 OpenAI 兼容模式,它会破坏 OpenClaw 对工具调用(Tool Calling)功能的支持。

如果想更精细地控制每个模型,可以在 models 数组中手动定义它们。

{

"models": {

"providers": {

"ollama": {

"baseUrl": "http://ollama-host:11434",

"apiKey": "ollama-local",

"api": "ollama",

"models": [

{

"id": "gpt-oss:20b",

"name": "GPT-OSS 20B",

"contextWindow": 8192,

"maxTokens": 81920,

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }

}

]

}

}

}

}

通过这种方式,可以完全掌控 OpenClaw 能使用的 Ollama 模型列表及其相关参数。

模型的使用与切换

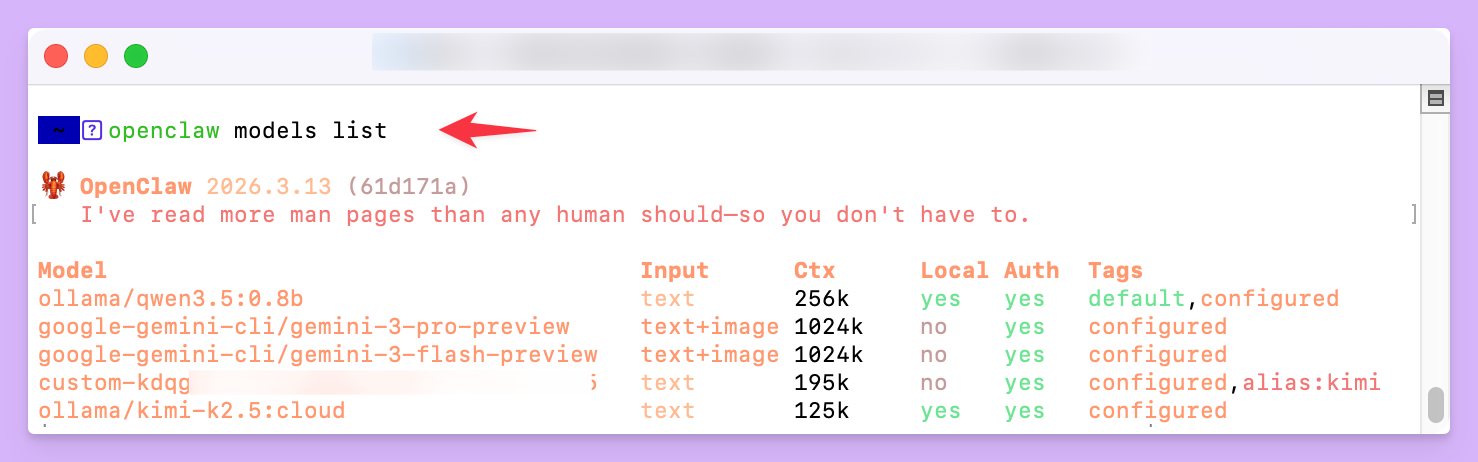

无论通过哪种方式配置完成,Ollama 的模型现在都已经成为 OpenClaw 的一部分。可以通过 openclaw models list 命令查看所有可用的模型,其中 Ollama 模型的 ID 会以 ollama/ 作为前缀。

openclaw models list

如果希望将某个 Ollama 模型设置为默认的主要模型,可以使用 openclaw models set 命令。

openclaw models set ollama/qwen3.5:0.8b

更持久化的配置方式是在配置文件中指定。可以设置一个主模型(primary),并提供几个备用模型(fallbacks),当主模型调用失败时,OpenClaw 会自动尝试使用备用模型。

{

"agents": {

"defaults": {

"model": {

"primary": "ollama/gpt-oss:20b",

"fallbacks": ["ollama/llama3.3", "ollama/qwen2.5-coder:32b"]

}

}

}

}

这样的配置为智能体的稳定运行提供了保障。

常见问题排查

在配置过程中可能会遇到一些问题,这里列举了几个常见情况及其解决方法。

Ollama 未被检测到

如果 OpenClaw 提示找不到 Ollama,首先要确认 Ollama 服务是否正在运行。

ollama serve

如果你使用的是自动发现模式,请检查 OLLAMA_API_KEY 环境变量是否已正确设置,并确保配置文件中没有显式的 models.providers.ollama 条目,因为它会覆盖自动发现。

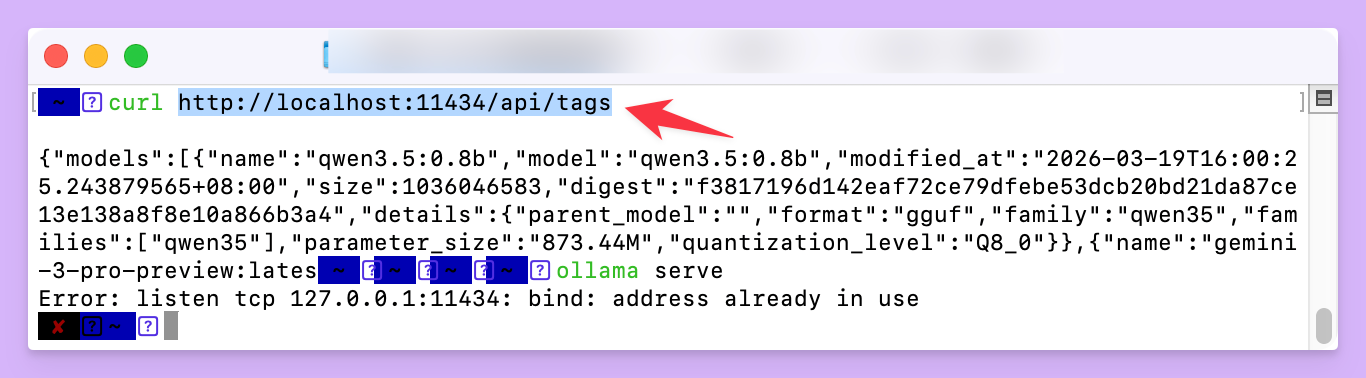

可以通过 curl 命令测试 Ollama API 是否可以访问。

curl http://localhost:11434/api/tags

如果此命令能返回 JSON 数据,说明 Ollama 服务是正常的。

看不到可用的模型

如果在 openclaw models list 的输出中没有看到预期的模型,请先用 ollama list 确认该模型是否已在本地安装。如果没有,使用 ollama pull 或 ollama run 下载即可。

ollama pull llama3.3

对于自动发现模式,新模型在下载后应该会自动出现在 OpenClaw 中。对于显式配置,需要手动将其添加到配置文件的 models 数组里。

连接被拒绝 (Connection refused)

这个错误通常意味着 Ollama 服务没有启动,或者 OpenClaw 配置的地址或端口不正确。请检查 Ollama 服务的运行状态,并核对配置文件中的 baseUrl 是否与 Ollama 的实际监听地址匹配。

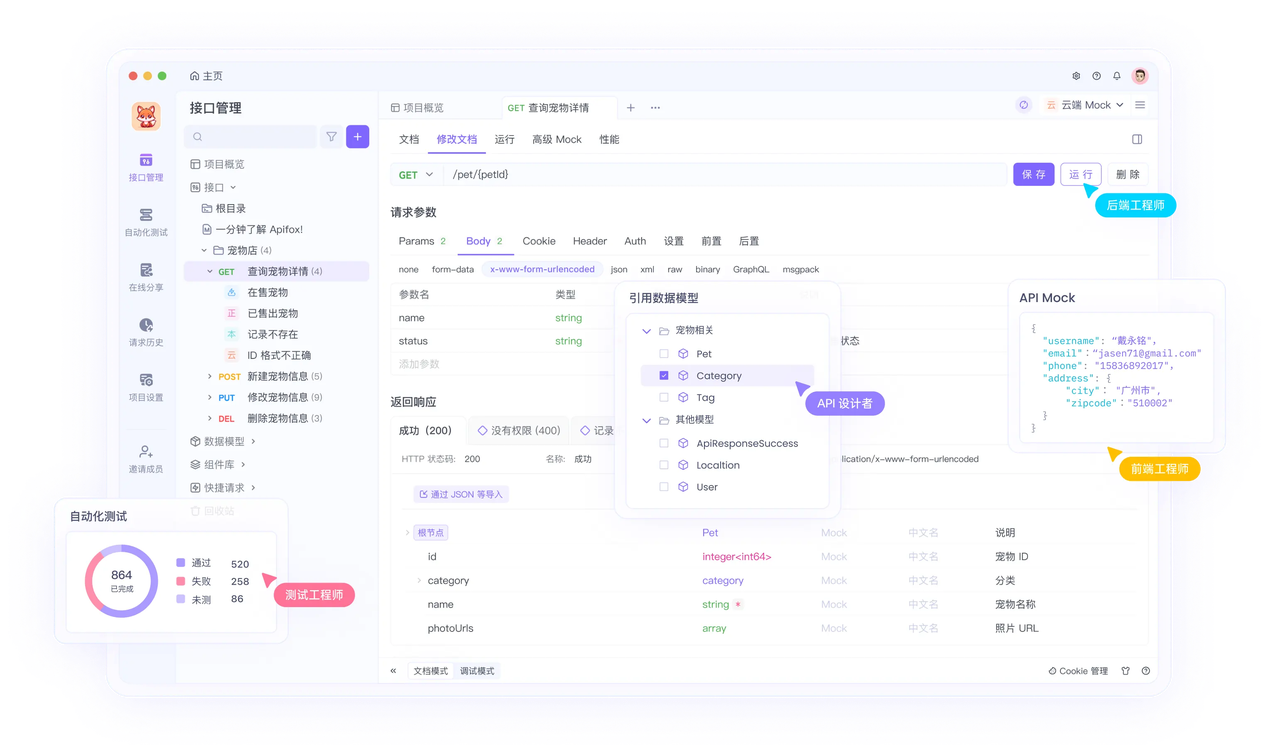

开发必备:API 全流程管理神器 Apifox

介绍完上文的内容,我想额外介绍一个对开发者同样重要的效率工具 —— Apifox。作为一个集 API 文档、API 调试、API 设计、API 测试、API Mock、自动化测试等功能于一体的 API 管理工具,Apifox 可以说是开发者提升效率的必备工具之一。

如果你正在开发项目需要进行接口调试,不妨试试 Apifox。注册过程非常简单,你可以直接在这里注册使用。

注册成功后可以先看看官方提供的示例项目,这些案例都是经过精心设计的,能帮助你快速了解 Apifox 的主要功能。

使用 Apifox 的一大优势是它完全兼容 Postman 和 Swagger 数据格式,如果你之前使用过这些工具,数据导入会非常方便。而且它的界面设计非常友好,即使是第一次接触的新手也能很快上手,快去试试吧!